先週開発を始め、技術白書をまとめたVibe Playground。

詳しくは開発を始めたときの投稿と、技術白書を読んでください。

前回までの状態だと、今ひとつVibe(場の雰囲気)が生成画像に反映されていなかったので、画像生成プロンプト(Stable Diffusion用プロンプト)を生成するためにLLMに指示を出す部分のチューニングをしました。

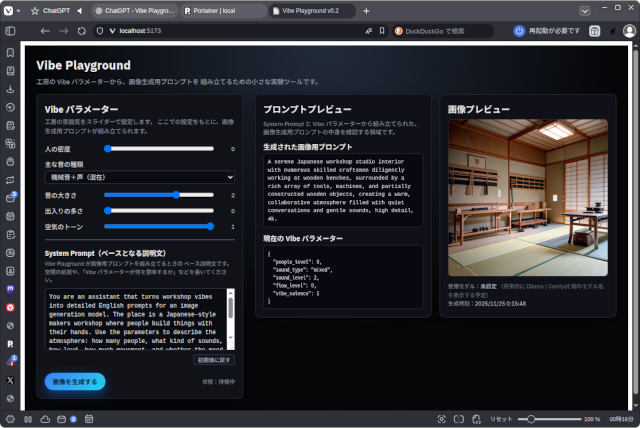

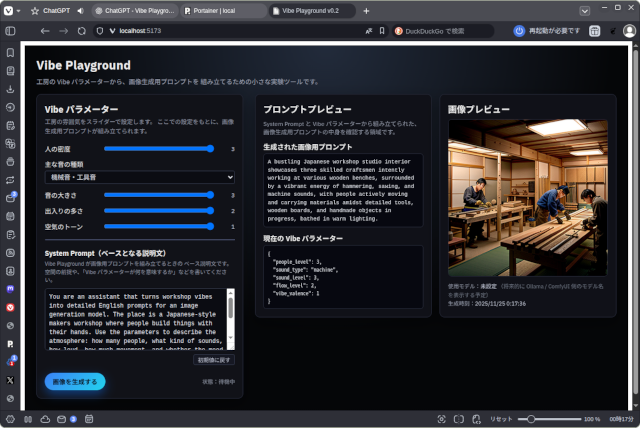

2つの雰囲気を比較したものをお見せします。

静かな雰囲気のVibe

賑やかな雰囲気のVibe

使用したLLMはgpt-oss 20bの4bit量子化版です。

それらしい雰囲気が再現されていると言えると思います。

本番のシステムができるのはだいぶ先のことです。

投資ができる段階がきたら一気にやるつもりです。

ざっくりシステムの完成形を説明します。

- ZIKUU工房内・外にセンサーを設置してセンサーネットワークを構成する

- MQTTを使って、リアルタイムにセンサーのデータを収集する

- 数分おきに、収集した場のデータをまとめてVibeデータを生成する

- AI塾長が文章生成する際のVibeデータをコンテクストにセットして使用する

実際にAIが理解をするわけではありませんが、ZIKUUという場(様々な文書と雰囲気)を理解しているようにAIが振る舞うことになります。

システムの運用がはじまっても、しばらくは実験です。

いずれ、ZIKUUに限定せずに、会社や工場や街の雰囲気を見ながら動くAIを実現できたらいいなと思っています。

「Vibe Playgroundの調整〜AIで場の雰囲気を扱うために」への2件のフィードバック