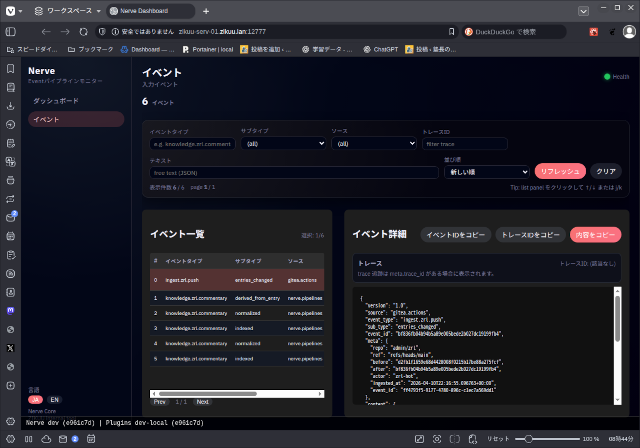

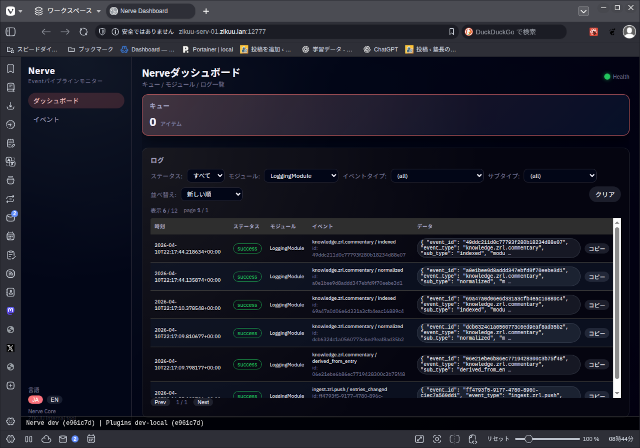

運用を始めてから「動いていればいい」程度できていたNerveのUIを調整しました。

やったのは

- ZIKUU内部の認証サーバーと接続してユーザー認証をする

- レイアウトの調整

- 一覧へのページャー追加

- i18n対応

- イベントトレーサビリティーの向上

みたいなこと。

これで正式な本番アプリケーションになりました。

合わせてZIKUU内のポータルサイトを調整しています。

これらがすべて本番運用に入ったときがZIKUU v1.0の完成です。

緑色の枠

主にZIKUU内資料で、人間が読む形式の文書群です。

Research Library、ZIKUU論文集、ZIKUU基礎教科書は、ベクターデータベースにも入っていて、それをAIが読みます。

最終的に、ZIKUUシステムすべてを技術文書化して、ここに項目を追加する予定で、人間とAIが読める文書とするので、AI塾長がZIKUU v1.0の仕組みを語ることができるようになります。

そこまで行くと、AI塾長とはこんな会話ができるようになります。

ユーザー

「Nerveがうまく動いていないみたいだけど」

AI塾長

「Nerveは、外部からイベント受取り、内部のキューに入れてから、データ処理パイプラインが走る仕組みになっています。イベント受信、キューイング、パイプラインの選別、パイプライン実行のどこかに問題があるはずです。まずは、このコマンドで状況を調べてください。一緒に原因を究明しましょう。」

紫色の枠

オープンソースのツール群です。

Nextcloud、KODI、OpenWebUIが使われています。

茶色の枠

ZIKUU開発のアプリケーション群です。

グレーアウトされているものについては、開発中、設計中、コンセプト確認中の段階にあります。

Radio Mind

- Quadrifilar HelixアンテナとSDRでFM放送を受信してAI文字起こしをする

Whisper Playground

- YouTube動画から文字起こしするAIアプリ

Vision Playground

- 画像の説明をするAIアプリ

- バックエンドはAPIサーバーになっていて、ZIKUU内の画像解析処理を担当する

Word Eye

- Pivotサービスのクライアントアプリで、国際ニュースを分析し、世情を観測する

Earth Vision

- JAXA APIを使用して地球観測データを収集し、Pivotサービスに投入する

Vibe Playground

- センサーネットワークや監視カメラの情報からVibeモデル(場の雰囲気を数学的なモデルに変換したもの)を生成するAIアプリ

- ZIKUU v1.0に含めるかどうかは検討中

Nerveダッシュボード

- イベント受信、キューイング、データの圧縮・意味づけ・変形、保存・配信をするZIKUUの中枢神経

- 上記アプリや文書群の多くが生成物をこれに流す

Pivotサービス

- データの正規化・観測軸抽出・標準化・保存を行い、多次元意味空間を作り出すシステムでZIKUUシステムの中核ソフトウェア

- 多次元意味空間を視点(観測軸)を変えて観測断面を作り出して探索するツール

- 人間とAIが観測断面を見る

AI塾長

- ベクターデータを見てRAGを実行

- Pivotを見て意味空間の探索

- コミュニティーメンバーとの対話

- ZIKUUを知っているAI

ZIKUU v1.0はここまで。

FruitChainとKAGURAはオプション。

- FruitChainは、ミュニティーへの貢献と信頼を視覚化するコミュニティ通貨システム

- KAGURAは、LLMオーケストレーションを使った思考の可視化システム

この2つは必須ではありませんが、あったら面白いというもの。

ZIKUU v1.0は、

- 圧縮して1台のPCに収まるZIKUU Mini

- ミニPCに収めて持ち運べるZIKUUになるZIKUU Seed

に展開する予定。

ZIKUUは、

- 人・・・技能者、生活者、生産者

- 場・・・工房や研究室

- 設備・・・IT機器、加工機械、道具

- 思考補助装置・・・上記システム

が一体となったシステムで、

- ZIKUU Miniは、このすべてを持った、ZIKUUの小さなコピー拠点のような場所に置かれることを想定したもの

- ZIKUU Seedは、遠隔拠点を構築するための種

という位置づけになります。

これらを総称して文明のバックアップ装置あるいは文明の再起動装置と呼びます。

生きている間に、そこまでなんとか完成させたいと思っています。

大げさに見えるかもしれませんが、もうすぐv1.0は完成します。

「NerveダッシュボードのUI調整とZIKUU v1.0進捗」への1件のフィードバック