年末年始に気になっていた部分を修正しました。

そういうものがたくさんあります。

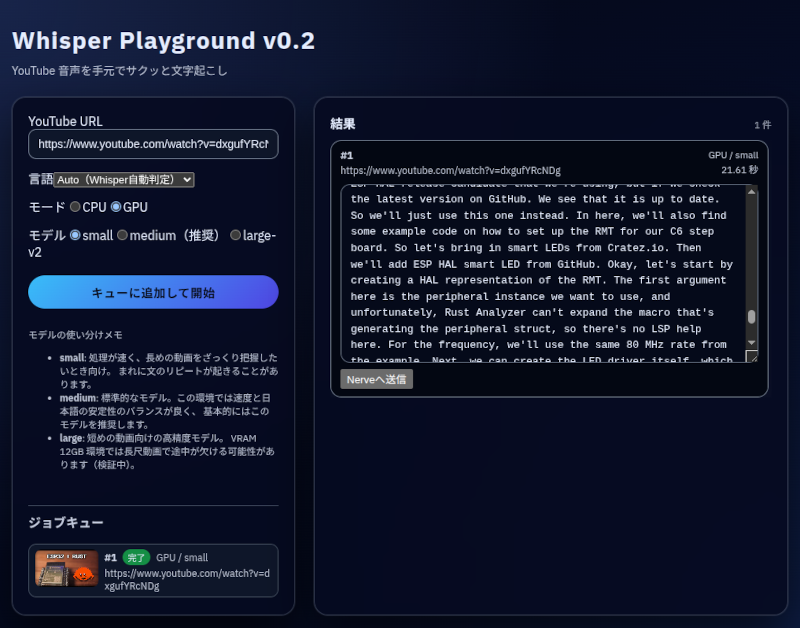

文字起こしする言語のデフォルトを日本語にしていたのが原因で、外国語の文字起こしがひどいことになっていました。デフォルトを自動検出にした上で、日本語、英語、自動検出を選択できるようにしました。

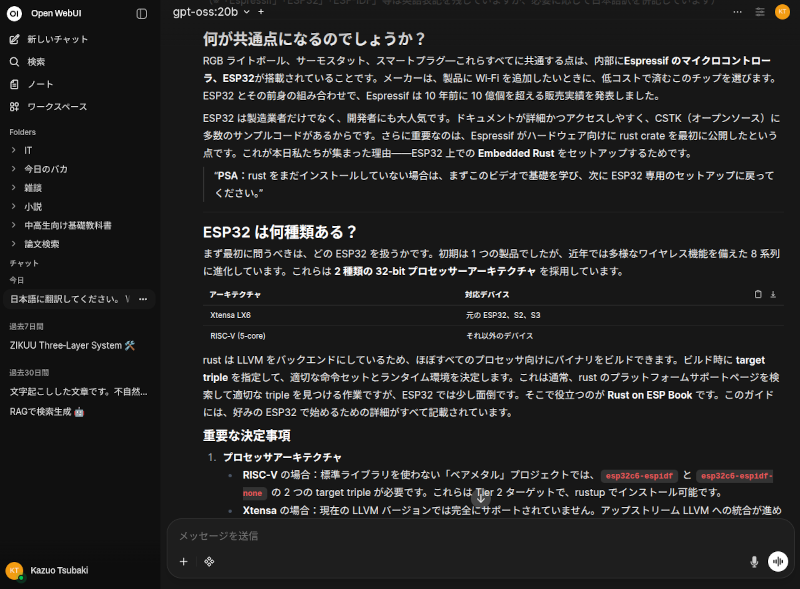

自動的に日本語で文字起こしさせると翻訳がひどいので、翻訳にはローカルLLMを使います。

ローカルLLMを使った翻訳を手動または自動で呼び出すようにするのは簡単ですが、Nerveにデータを送信して、翻訳パイプラインを通せばいいだけ。個々のアプリを多機能化するよりは、アプリは小さく確実に実装し、処理の単位を分割した方がシステム全体の見通しは良くなります。

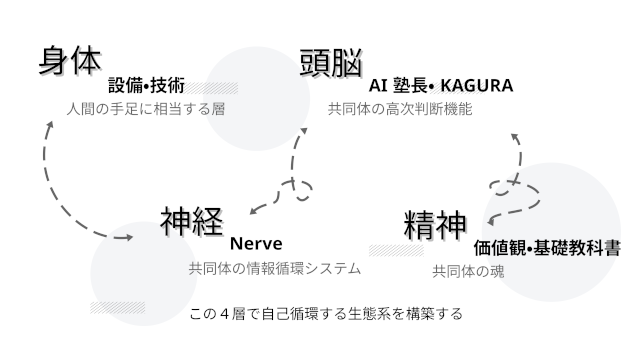

この構造ならば、小さなアプリを気軽に作って、速く実験を回して、システムに統合していくことができますし、ZIKUUのような資金が潤沢でない組織でも、小さく進めることができます。

前回投稿の「論文検索ボットを作る」は論文という外部知識を、前々回投稿の「Discord用の調査ボット」は汎用的なWeb検索結果という外部知識を、そしてこのWhisper PlaygroundはYouTube動画音声という外部知識を、共同体内に染み込ませるための道具です。すべてがNerveを経由して、AI塾長に渡されます。

下のZIKUU生態系モデルで言えば、これらの外部知識収集ツールは身体(センサー)の一部です。

さらに、

- Visionモデルを使って、Discordに写真を投稿するだけで、活動を記録するアプリ

- センサーネットワークを構築して、集めた場の状態をモデル化してパイプラインを流すアプリ

などを作ってもいいかな。

このZIKUU生態系モデルは、ZIKUU専用モデルではありません。

身体=何を情報として共同体に染み込ませるか、精神=共同体の規範や思想、を入れ替えれば、神経と頭脳の改造なしで、共同体の個性が出せます。

ZIKUUのシステムはすべてローカルで動くので、パッケージ化してコピーするのが簡単です。

たぶん、Ansibleなどの構成管理システムで環境構築できるようにすれば、ミニPCを買ってくる、Ansibleを動かす、1時間か2時間後にはシステムが動く、そういうこともできるでしょう。オープンソースのみを使うので、導入費用も抑制できます。

「Whisper Playgroundの修正」への1件のフィードバック