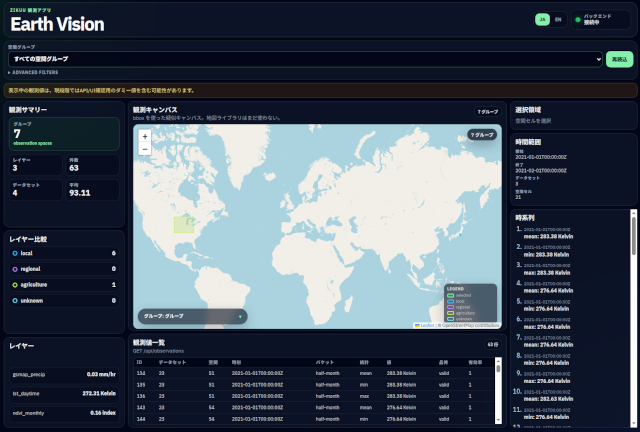

UIを調整して、これまで開発用の情報を表示していた部分を簡素化して、観測に必要な項目のみを表示するように、地図の操作を改善しました。

さらに、観測空間を増やして、ローカル、地域という尺度を導入しています。

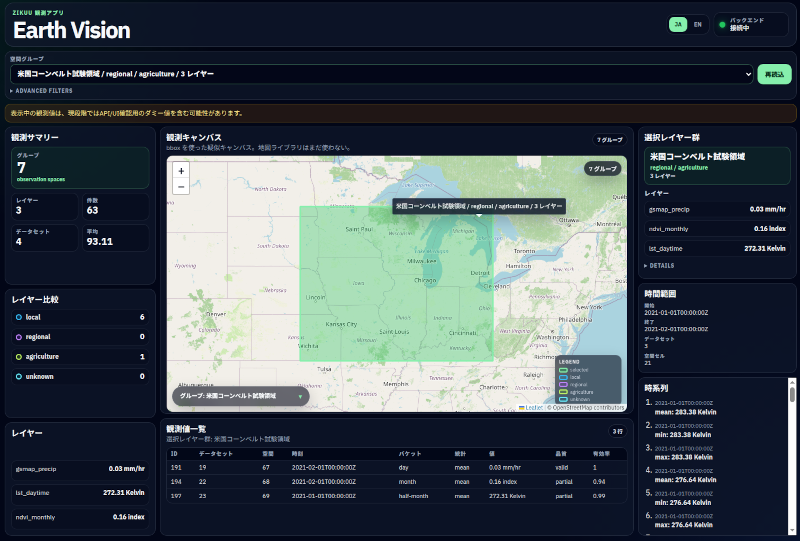

これは米国の穀倉地帯(地域尺度)の観測データを表示した様子。

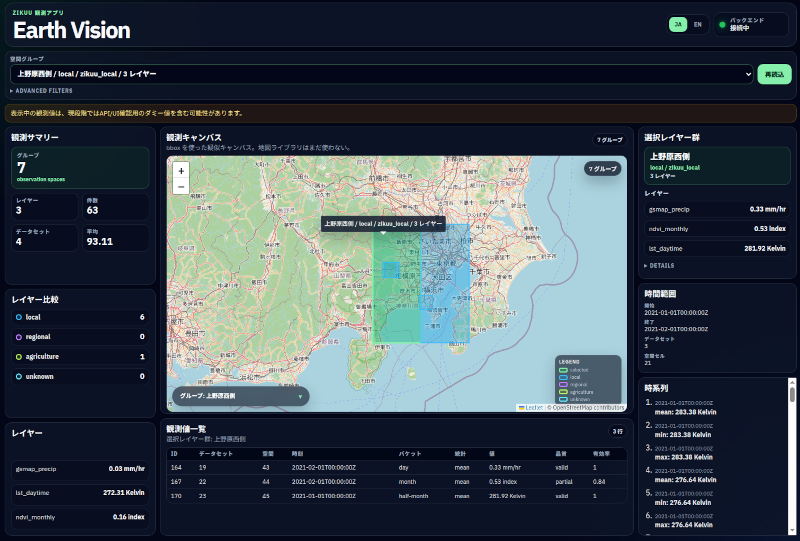

これは塾がある上野原の西側(ローカル尺度)を観測している様子。

観測空間は、次のような形式で追加できるようになっています。

{

"key": "us_corn_belt_test",

"display_name": "米国コーンベルト試験領域",

"description": "STEP9 agriculture observation validation area for a rough U.S. Corn Belt bbox. This is not an administrative or precise cropland boundary.",

"scale": "regional",

"domain": "agriculture",

"purpose": "agriculture_observation_validation",

"bbox": [-98.0, 37.0, -82.0, 46.5],

"tags": ["step9", "regional", "agriculture", "corn_belt", "usa", "test"]

}

これとサンプリング定義(現時点では降水量、地表温度、植生のみ)を使って、「どこの」「何を」データ収集するかを決めています。

時系列、観測空間、サンプリングデータのレイヤーの3つの軸で観測を行うことになりますが、現時点では時系列の扱いが弱いです。

Earth Visionは、

- 人工衛星のデータを使い

- 時空間を観測し

- 記録したデータをPivotサービスに配信してFactとして保存し

- 他のFact、例えばニュース報道などと比較して

- 何が置きているかを知る

観測装置になります。

食料価格の変動や戦争や紛争の兆候などの動きをコミュニティー内部に知識化して判断力を高めるといった使い方をすることになります。

ZIKUUは、

1.物理層・・・実際に生産や生活をする(工房、道具、生産技術、生活技術)

2.記憶層・・・知識を内部化する(Nerveとデータベース)

3.知識層・・・知識に構造を与える(Pivot Service)

4.判断層・・・人とAIが解析・解釈を行い判断する(AI塾長やEarth Vision、World Eyeなどの観測装置)

を回します。

物理層で起きたことは、記憶層→知識層→判断層と流れて、その結果を物理層にフィードバックする。

これの繰り返しです。

結果としてコミュニティーの生存能力を高める方向に行く。

それが狙いです。

「Earth Visionの観測能力を磨く」への1件のフィードバック